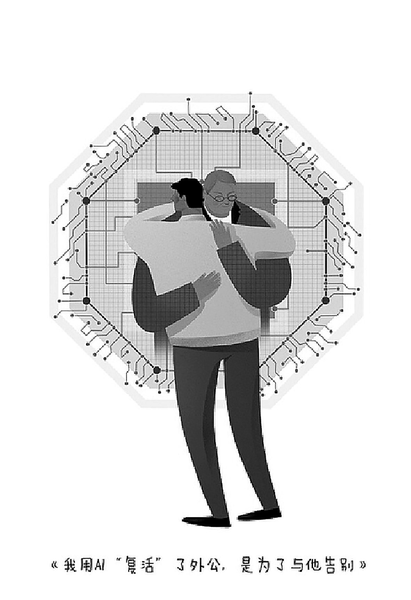

“复活逝者”,引来伦理和法律的双重审视

2024年10月10日

字数:1860

资料图片

资料图片 院教授张凌寒介绍,目前我国已有相关的规定。2023年1月生效实施的《管理规定》中,对通过人工智能技术生成合成数字人、使用他人生物识别信息合成数字形象等服务,都有相关的规定。

“根据这些规定,如果要生成他人的换脸、换声或者合成他人形象,应该得到当事人的单独同意。这也与我国个人信息保护法的相关规定是一致的,因为这些生物识别信息构成了敏感个人信息。”张凌寒说。

不过,目前从事技术“复活”的机构资质、AI“复活”发起方的权责、数字形象的技术应用边界、“数字人”产品的监督机制等许多问题,亟待解决。

在中国传媒大学文化产业管理学院法律系主任郑宁看来,制作方在利用AI技术数字“复活”逝者后,可能需要承担一些法律责任。因此,为保障逝者的人格权益,制作方只有经过逝者继承人的同意,才能进行相关“复活”操作。

另外,业内人士提出,在数据处理过程中,要更注重隐私保护和数据安全。

2023年,国家网信办、国家发展改革委、教育部等七部门联合发布《生成式人工智能服务管理暂行办法》(以下简称“办法”),进一步明确了生成式人工智能的行业发展规范。办法规定,提供者应当依法承担网络信息内容生产者责任,履行网络信息安全义务。涉及个人信息的,依法承担个人信息处理者责任,履行个人信息保护义务。

其次,不少专家提出,AI“复活”产品应恪守技术管理规范,加强内容“标识”。张凌寒谈到,无论这项技术如何发展,有一点应该明确,即仅限在怀念的场景下使用,不得与他人产生互动或者在公共场所传播,避免发生欺诈。因此,法律也要求生成合成的音视频,必须作出显式标识和隐式标识,避免公众混淆。

郑飞也认为,应比照人工智能在学术研究中的“披露性”原则,还应建立深度合成内容标注机制。“以显著、明确、无异议方式对虚拟数字人作出特别标注,让用户清楚知道其属性。”郑飞强调。

与此同时,左晓栋等专家表示,根据有关规定,相关技术服务提供者必须对“生成内容”进行“标识”;在已有原则性要求的背景下,可出台相关行业标准,要求相关技术服务提供者在生成式内容中添加“水印”,防止不法分子借用该技术实施违法犯罪活动。

专家还建议,要进一步落实相关平台的主体责任,处置借AI“复活”概念不当牟利的不法商家。实际上,我国已经出台了《管理规定》《互联网信息服务算法推荐管理规定》《生成式人工智能服务管理暂行办法》《科技伦理审查办法(试行)》等,为人工智能治理搭建了基本的规范体系,为行业规范划定了一些“红线”。

值得一提的是,虽然人工智能技术在我国兴起的时间不长,但此类规定的出台相对及时。不过,郑飞也谈到,这些“红线”或失之于宽、或失之于软。“失之于宽表现为缺少明确可执行的正负面清单,现有规定过于宽泛化,难以有效界定行为的违法性;失之于软表现为当前针对人工智能治理缺乏上位法规定,现有规范法律强制力不足,宜尽快制定出台人工智能法。”

除了法律法规的完善,行业自律、平台监管也很重要。“立法通常是滞后的,尤其在新技术领域。”郑宁谈到,总体而言,科技发展的边界应该在维护社会法治、保护个人权益和确保伦理底线的前提下进行。数字“复活”技术的推广需要更多的监管和规范,既保证技术的创新,也要保障人类的价值和尊严。除此之外,可以通过“软法”比如行业标准、企业自律行为等,在实际操作中发挥规范作用。

上海大学法学院教授陈敬根同样认为,画出底线和红线的“硬法”固然不可缺位,但为了弥补立法的滞后性,当前在人工智能等新兴领域应提倡设立更多的“软法”,即通过行业协会、团体组织等自发制定的规则,产生集体约束力,由此在法律底线之上起到行业监管的作用。

上海政法大学教授张继红也建议,更加重视人工智能领域的行业自律,通过国家标准、行业标准引导产业发展,以场景化的标准指引企业做好人工智能合规工作。

“不能放任AI‘复活’变成一门没有规矩和底线的‘生意’,尤其要保护对新技术不敏感的中老年用户群体。”中国法学会消费者权益保护法研究会副秘书长陈音江指出,有关平台要帮助中老年用户群体辨别深度伪造技术,取缔不当得利的违法违规商家,尽可能减少技术滥用带来的社会风险。

法律界人士建议,有关部门对AI“复活”的需求和其衍生的产业链要保持关注、合理辨析,在现行法律法规基础上做好数据保护、涉诈犯罪风险预防等方面的监管。

除了法律风险,还存在诸多伦理道德问题。北京航空航天大学法学院副教授赵精武介绍说:“为了解决这类问题,科技部在2023年9月发布了科技伦理审查办法,那么通过建立一个科技伦理审查制度来预防科技伦理层面的风险,AI逝者‘复活’也在被规制的对象里边。”

编辑/燕子(hchwyx7810@sina.com)